2026年2月は、企業サイトの流入や運用設計に影響しやすい動きが、主に3つありました。

ひとつは、Googleが公式に発表したDiscoverのアップデートです。次に、AI検索(AI Overviews / AI Mode)の表示や“サイト側でどこまでコントロールできるか”をめぐる議論が進みました。そして技術面では、Googlebotが取得するファイルサイズ上限がより明確になり、重いテンプレートを抱えるサイトでは「重要情報が読み取られにくい」リスクを確認する必要があります。

【2026年2月の要点】

✓Discoverは「ローカル性」「クリックベイト抑制」「専門性・一次性」を重視する方向へ

✓AI Overviews / AI Modeはリンク表示が変わり、クリック設計と計測の重要度が上昇

✓Googlebotは「HTML/テキストは先頭2MB」など取得前提が明確化。重いページの棚卸しが急務

<Pickup記事>

SEOとは?SEO対策の基本から具体的な施策手順や注意点を初心者にもわかりやすくプロが解説

目次

今すぐ無料で、

あなたのSEO対策費用を

シミュレーション!

簡単な質問に答えるだけで、

最適なSEOプランと費用が無料でわかります。

SEO対策を

行ったことはありますか?

Googlebotがクロールするファイルサイズの上限が明確化【2月3日】

2月上旬、Googleのドキュメントで「Googlebotがクロールするファイルサイズ上限」が明確に記載されました。検索向けのクロールでは、サポート対象のファイルは先頭2MB、PDFは先頭64MBを取得し、上限に達した時点で「フェッチ(クローラーがWEBページの情報取得し読み込むこと)」を止め、取得できた範囲の情報をもとにインデックス判断へ進める、と説明されています。

Google 検索のクロールでは、Googlebot はサポートされているファイル形式の最初の 2 MB と、PDF ファイルの最初の 64 MB をクロールします。

引用:Google Search Central 「Googlebot」

ここで押さえたいのは、「2MBを超えたら即NG」という単純な結論ではないことです。実務的に重要なのは、Googlebotが取得できる範囲の中に、評価や理解に必要な情報がきちんと収まっているかどうかです。

例えば、本文の本体、主要な内部リンク、パンくずリスト、構造化データなどがHTMLの後半に偏っていると、意図どおりに伝わらない可能性が出ます。また、タグやスクリプトの積み上げでHTMLが膨張し、肝心の内容が後ろへ押し出されているケースも要注意です。

企業が取るべき対応

直近で行うべき対応として、SEO担当とフロントエンド担当が連携し、主要テンプレート(トップ、カテゴリ、記事、商品など)の「生HTMLサイズ」を実測して、重いページ候補を特定してください。

<HTMLサイズの確認方法>

①ブラウザでの確認: Chromeで該当ページを開き、右クリック>「名前を付けて保存」で保存されたファイルのサイズを確認する。

②デベロッパーツールの活用: 「Network」タブを開き、ページをリロード。「Doc」フィルタを選択し、該当リソースの「Size」列(Transferredではなく実際の容量)を確認する。

そのうえで、本文・主要見出し・内部リンク・構造化データなどの重要な要素がHTMLの先頭側に配置されているかを点検します。ここを先に確認しておくと、後工程の修正がスムーズになります。

次に「HTMLを肥大させている要因」を棚卸しし、以下のような修正を行い、改善することを推奨します。

- 不要なタグの削除:未使用プラグインの停止、コメントアウトの削除、重複するトラッキングコードの削除 など

- 読み込みの遅延化:画像(image)に「loding=”lazy”」の付与 など

- インラインスクリプトの整理:HTML内に直接書き込まれた大量のCSS(<style>)やJavaScript(<script>)を、外部の.cssや.jsファイルに移行

GooglebotはHTML内で参照されるCSS/JSなどを別リソースとして取得します。同様に上限制約を受ける可能性がある点も踏まえ、レンダリング負荷の抑制まで含めて検討すると安心です。

中長期的には、開発責任者が「HTML肥大を起こしにくい設計ルール(タグ管理、テンプレ方針、計測の統合など)」を定め、運用で戻らない仕組みにしておくと、SEOだけでなく保守性や速度の改善にもつながります。

ポイントは「2MBを超えないこと」そのものではなく、「重要情報がクローラーの取得範囲外へ押し出されない設計」を安定的に再現できる状態を作ることです。

■参照ソース

・Google Search Central 「Googlebot」、「ドキュメントの最新の更新内容」

・Crawling infrastructure「Google のクローラーとフェッチャー(ユーザー エージェント)の概要」

「Discoverコアアップデート」の公開【2月5日】

2月、GoogleはDiscover向けに「2026年2月Discoverコアアップデート」を公開し、Discover面の露出ロジックを広く調整したと説明しました。

今回の更新では、主に次の点が改善されます。

・ユーザーの国に拠点を置くウェブサイトから、地域に関連性の高いコンテンツをより多く表示する

・Discover での扇情的なコンテンツやクリックベイトの削減

・特定の分野の専門知識を持つウェブサイトから、より詳細でオリジナルでタイムリーなコンテンツを、サイトのコンテンツに関する Google のシステムの理解に基づいて表示する

引用:Google Search Central 「2026 年 2 月の Google の Discover コア アップデート」

主な方向性としては、国に基づくローカル性の高いコンテンツの表示、クリックベイト(誇張されたタイトルや画像で、クリックを誘導する手法)の抑制、専門性があり一次性と鮮度の高い“深いコンテンツ”の評価などが挙げられています。

ステータスダッシュボード上では、このアップデートは米国の英語ユーザー向けに開始し(※将来的に拡大予定)、ロールアウト完了は2月末として記録されています。なお、2月のランキング更新として公式に掲載されているのはDiscover更新のみです。

企業サイトの運用で効きやすいのは、「煽り気味のタイトルでクリックを取りにいく」よりも、「ユーザーのニーズを意識したオリジナルで深い内容を、誤解なく丁寧に伝える」方向へ寄せる必要性が高まった点です。

Discover流入がある企業ほど、本文の中身に加えて、タイトル・冒頭の要約・画像の選び方まで含めたコンテンツ方針の見直しが重要になります。

企業が取るべき対応

直近で行うべき対応として、SEO担当はGoogleサーチコンソールのDiscoverレポートで、アップデート前後のクリック・CTR・上位URLの変化を確認してください。

Discoverは変動が出ても原因が特定しづらいことが多いため、まずはどの記事群のパフォーマンスが低下したかを「記事テーマ」や「記事カテゴリ」、「表現の傾向」などを小さくカテゴライズして把握することがおすすめです。

また、編集・広報が中心となり、落ちた記事のタイトルと導入文を見直します。誇張や断定、煽り表現を減らし、「①結論→②根拠→③具体」の順で正確な情報が正しく伝わるようなコンテンツに改善をすると良いでしょう。

あわせて、独自データ、現場の知見や成功事例、専門家による監修コメント、一次データやエビデンスのリンクなど、その記事だからこそ価値が出る要素を追加し、内容の深さを補強していきます。

中長期で取り組みたい内容としては、Discoverで伸びた記事・伸びなかった記事を見比べ、テーマ選定、構成、画像、更新頻度、著者情報の出し方などを社内ガイドとして型化すると、場当たり的な運用を減らせます。

Google自身も「Discoverに載る確率を上げるための追加情報」をドキュメントに追記しているため、その観点を運用に取り入れていくとよいでしょう。

■参照ソース

・Google Search Central 「2026 年 2 月の Google の Discover コア アップデート」、「ドキュメントの最新の更新内容」

・Google Search Status Dashboard「February 2026 Discover update」

AI検索をめぐる「サイト側コントロール」についてGoogleから公式発信【2月中旬】

2月はAI Overviewsを中心に、「サイト・出版社がAI要約で使われることをどこまで制御できるか」という論点が一段進みました。欧州では出版社団体が、AI要約によるトラフィックの減少や利用の在り方をめぐり、EU当局に申し立てたと報じられています。

英国では、競争当局が公表した提案に、AI Overviewsにおける出版社側のコントロール強化や、アトリビューションに関する実務対応が盛り込まれ、意見募集の締切が2月25日とされています。

さらにGoogleは公式ブログで、robots.txtなどのオープン標準に基づく従来のコントロールに加え、強調スニペット(Featured Snippets)やプレビュー制御、Geminiモデル学習に関する「Google-Extended」などの仕組みに触れたうえで、Searchの生成AI機能向けに“特化したopt-out”を検討している、と説明しています。

現時点では、企業として「すぐに使える新コントロールが確定した」と言い切れる段階ではありません。一方で、AI検索は「流入経路」であると同時に、自社コンテンツの利用・許諾の議論も含む局面に入りつつあります。

だからこそ、マーケ・SEO部門・担当者だけで抱えず、法務・広報も含めて方針を持つ重要性が高まっています。

企業が取るべき対応

SEO担当は、自社の主要クエリでAI Overviewsが出るかどうかを定点観測し、出る場合は「どのページが参照されているか」を記録することが重要です。AI面の露出は変化が速いため、最初は見える範囲からで問題ありません。

また、マーケ責任者と法務が中心となり、既存のコントロールを棚卸しします。たとえばrobots.txtを含む各種制御や、AI要約にも適用され得るプレビュー系の扱いを整理し、「AI要約で引用されることを許容するのか」「条件付きで許容するのか」「原則控えたいのか」を社内合意として文章化します。

Googleが生成AI検索向けの新たなコントロールを検討していると述べている以上、いま方針を作っておくと、仕様が出たときに判断が早くなります。

中長期的な取り組みとして、AI面の露出を“上流の認知”として捉え、指名検索や比較検討、最終的な問い合わせ・購買までの導線設計を見直してください。AI要約で完結されやすいテーマほど、「手順」「判断基準」「比較表」「注意点」「一次データ」など、要約だけでは済まない価値をサイト内に残す設計が効いてきます。

■参照ソース

・Google The Keyword 「Our approach to website controls for Search AI features」

・GOV UK「CMA proposes package of measures to improve Google search services in UK 」

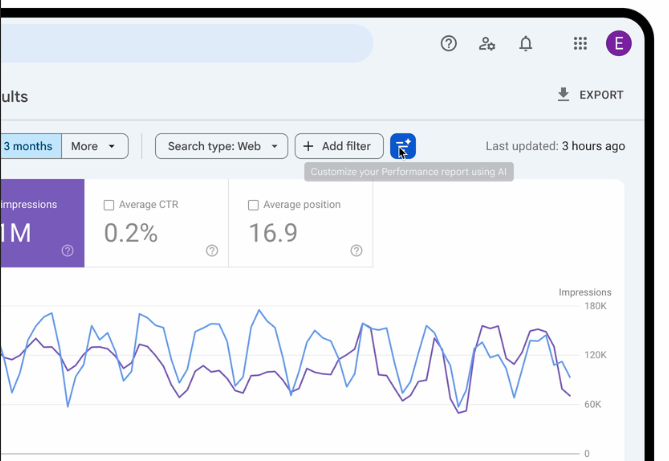

Googleサーチコンソールの「AI-powered configuration」が全ユーザーに提供【2月中旬】

2月中旬、Googleサーチコンソールのパフォーマンスレポートで、「表示したい分析内容」を自然言語で伝えるとフィルタ設定や比較条件を自動で組み込みする「AI-powered configuration」について、Google Search Centralから「全員が使える」と報告がされました。

カーソルの箇所が「AI-powered configuration」

(引用:Google Search Central「新しい AI を活用した構成で Search Console の分析を効率化する」)

この機能の実務的な価値は、担当者ごとの操作の癖やリテラシーで分析条件がズレる問題を減らせる可能性がある点です。例えば、「直近28日でクリックが落ちたページを見たい」「国別・デバイス別に比較したい」といった、よく使う分析レポートの内容をテンプレートとすることでGoogleサーチコンソールが利用しやすくなります。

一方で、AIが意図を誤解する可能性がゼロとは言えません。便利になったぶん、作られた条件を人間が検算する運用をセットにしておくと、上司報告や意思決定での手戻りを防ぎやすくなります。

企業が取るべき対応

SEO担当者は、自社アカウントで当該UIが表示されるかを確認し、使えるメンバーと使えないメンバーが混在する可能性もあるため確認をしておきましょう。Googleからの案内では全員が利用できると記載されていますが、実際の表示はアカウントやタイミングで差が出る可能性があります。

また、SEO責任者は「社内で使うプロンプト」をいくつか作り、テンプレとして保存することが重要です。ポイントは、分析の目的に応じて、誰が利用しても同じ結果になりやすいプロンプトを作成することです。加えて、期間・国・デバイス・検索タイプなどの条件が意図どおりかを確認するチェック工程も含めておくと安心です。

中長期的には、レポート作成の属人化を減らし、効率化することを目標にするといいでしょう。分析速度が上がるほど、PDCAサイクルを回しやすくなります。

■参照ソース

・Linkedin「Google Search Console AI Configuration Now Live」

・Search Engine Land「Google Search Console AI-powered configuration rolling out」

「AI Overviews / AI Mode」でリンクがより目立つUIに変更【2月中旬】

2月中旬、AI OverviewsおよびAI Mode内で、リンクがより目立つ形で表示されるUI変更が展開されたと報じられました。デスクトップでは、リンク群にホバーするとポップアップでサイト情報を見せる例が紹介されており、「サイトへ移動して深掘りする動機を作る」ことを意図した調整とも読み取れます。

ただし、この変更でクリックが必ず増えると断定はできません。報道側でも、Googleサーチコンソールだけでこの変化を直接測りにくい点が触れられており、企業としては「露出が変わったか」「流入が変わったか」を自前で観測できる形にしておく必要があります。

ここで効いてくるのが、AI経由の流入計測です。Ahrefsは2月、ChatGPTとGoogleの規模比較や送客の差に関する分析を公開し、「AI利用が伸びても送客モデルはGoogleと異なる」といった示唆を整理しています。数字の前提には注意が必要ですが、「AI流入はゼロではない。一方で主戦場はまだ検索」という前提で、計測だけ先に整える判断は合理的です。

企業が取るべき対応

SEO担当は主要クエリでAI Overviewsの出現有無を把握し、出る場合は「自社が参照されているか」「参照されているならどのコンテンツか」を記録してください。あわせて、GA4でAIからの流入を計測・可視化する準備を始めます。セッションの参照元/メディアでAIからの流入が手軽に確認ができます。また、カスタムチャネルグループを作れば、参照元ベースで“AI流入”を自社ルールでまとめられます。

コンテンツ責任者は、AI要約だけで済まない価値を増やす改修に着手してください。例えば、結論が先に分かるリード文、一次情報(独自データ、現場での知見や成功事例、専門家によるコメント)、比較表、判断基準、手順、注意点などを追加し、「クリックする理由」をページ内に作ります。AIで見つけられても、最終的に自社を選んでもらうには、この差分が効いてきます。

中長期で取り組みたいこととして、指名検索や問い合わせへつながる導線(資料請求、事例、問い合わせ、見積もり、店舗案内など)を設計し、AIと検索の両方で見つかるコンテンツに仕上げることで、流入の取りこぼしや機会損失を減らすことにつながるでしょう。

■参照ソース

・Googleアナリティクスヘルプ「カスタム チャネル グループ」

・Ahrefs blog「ChatGPT Has 12% of Google’s Search Volume but Google Sends 190x More Traffic to Websites」

・Search Engine Land「Google launches more visible links in AI Overviews and AI Mode」

検索結果画面に短時間の障害が発生【2月下旬】

2月下旬、Google Search Status Dashboardで「Serving」に関する短時間の障害が記録されています。ステータス上は米国太平洋時間の記載ですが、日本時間に直すと2月25日昼前後に、検索結果配信が不安定だった可能性がある時間帯が存在します。

こうした外部要因は、GSCや順位計測ツールでノイズとして残りやすく、単日の上下だけで結論を出すと判断を誤ることがあります。特に施策実施直後の評価では、外部要因を切り分ける癖をつけておくと安心です。

企業が取るべき対応

今後SEO担当者は大きな急落・急騰を見つけたら、まずSearch Status Dashboardを確認する運用を一次対応として決め、チーム内で統一することを推奨します。

また、分析・アナリスト担当は、GSC/GA4に注釈(いつ・何があったかのメモ)を残す運用を整備し、後から検証できる状態を作ります。Search側・自社側の両方の出来事が追えるだけで、レポートの説得力が上がります。

中長期で取り組みたいこととして、施策評価を単日で確定しないルール(例えば、7日〜14日で傾向を見る)を持ち、外部要因に振り回されない判断基準を作るのがおすすめです。

■参照ソース

・Google Search Status Dashboard「Serving was experiencing an issue」

「AIで量産した“内容の薄いサイト”は持続しにくい」という検証が話題に【2月下旬】

2月下旬、Search Engine Landで、AI生成を含むプログラマティックな量産サイトを題材に「スパムシステム上、信頼や一次性が薄いサイトは持続しにくい」という趣旨の検証記事が公開されました。

これはGoogleの新しい公式アップデート告知ではありませんが、AI生成コンテンツが一般化するほど、「なぜこのサイトが存在するのか」「誰の一次経験なのか」といった“土台”の部分が評価につながりやすいと整理ができます。

企業サイトでは、量産に寄りすぎるとブランド毀損や法務リスクにもつながり得ます。AIは制作支援として活用しつつ、最終成果物は“自社の言葉と根拠”で整える、というバランスが現実解です。

企業が取るべき対応

コンテンツ責任者は既存記事を棚卸しし、「自社の一次情報が薄い」「同業の一般論に寄りすぎている」ページを洗い出してください。全量でなく、重要カテゴリからで十分です。

また、編集担当者と現場部門が協力し、一次情報を差し込める設計に変えていきます。例えば、社内データ、顧客事例、現場のプロセス、失敗談も含む学び、判断基準など、“その会社だから書ける要素”を追加し、薄く見えない形に整えます。

併せて、AIを使う場合の制作ガイドとして、根拠を必須で設定する、引用情報の取り扱い、レビュー体制、著者・監修者情報、記事の更新ルールなどを決め、品質を再現できる運用ができると理想的です。

■参照ソース

・Search Engine Land「Google’s spam update vs. AI affiliate sites: An SEO experiment」

・Google Search Central「有用で信頼性の高い、ユーザーを第一に考えたコンテンツの作成」

まとめ

2026年2月は、Discoverの公式コアアップデートで露出の前提が動き、AI検索はリンク表示・サイト側コントロールの議論が進みました。技術面ではGooglebotの取得上限が明確化され、重いテンプレートの点検がより重要になっています。

来月に向けては、まずDiscoverの前後差分を把握し、次にHTML肥大の棚卸しを行い、AI流入計測の土台を整える──この順で「見える化→改善→再計測」を回していきましょう。

徹底的にSEOするならランクエスト

✓SEOに関するノウハウがない...

✓SEOを実施するリソースがない...

✓初めてのSEO何から手をつければいいか分からない...

ランクエストは、お客様の手を煩わせることなく、SEOで上位化するために必要な改善案の作成から実装までワンストップで対応します。現状のWebサイトの課題やSEOのお見積もりを知りたい方はぜひお気軽にランクエストにご相談ください。